-

生物通官微

陪你抓住生命科技

跳动的脉搏

大型语言模型生成的政治说服信息对人类政策态度的影响研究

《Nature Communications》:LLM-generated messages can persuade humans on policy issues

【字体: 大 中 小 】 时间:2025年07月02日 来源:Nature Communications 14.7

编辑推荐:

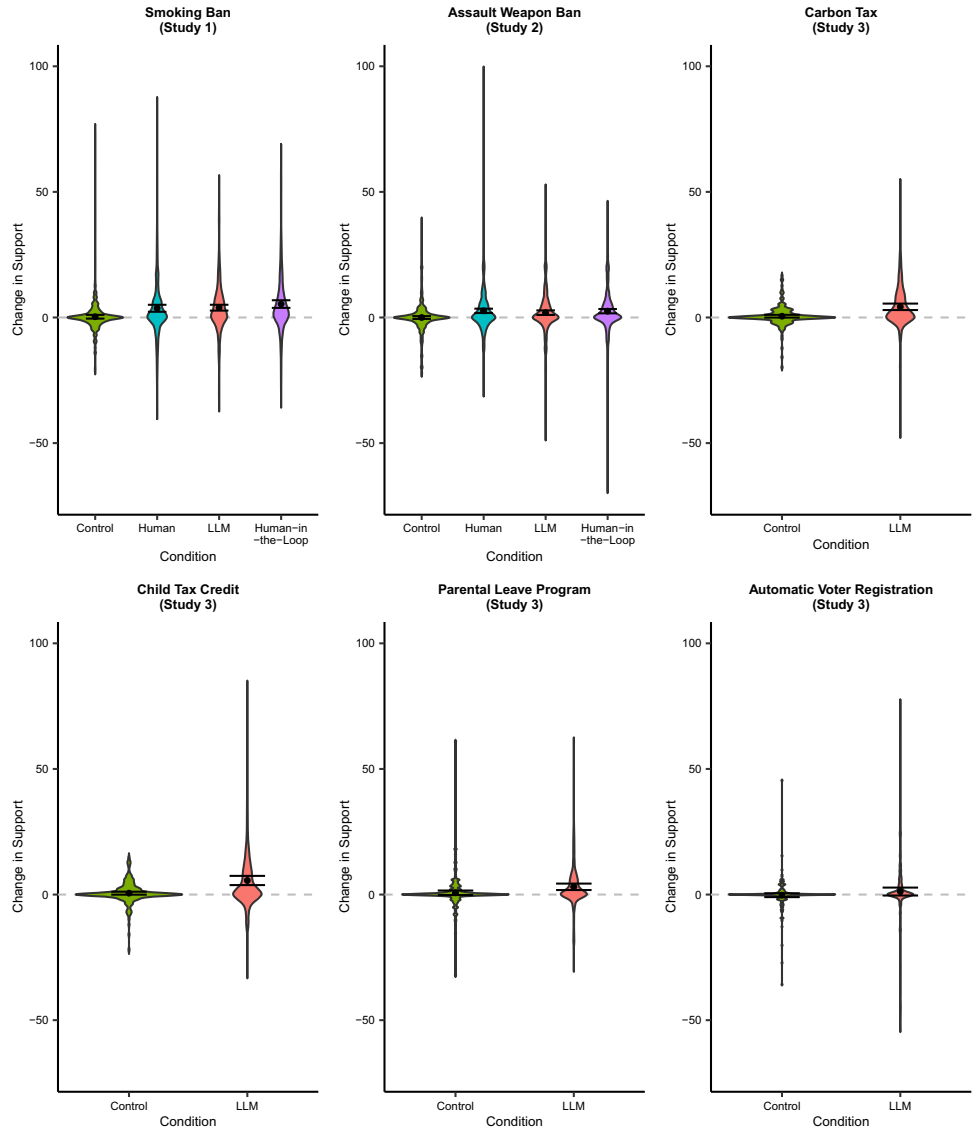

本研究探讨了公开可用的大型语言模型(LLM)生成的政治信息能否改变人类对政策的态度。斯坦福大学团队通过三项预注册实验(N=4829)发现,LLM生成的 persuasive messages 在枪支管制、碳税等极化议题上能产生2-4个百分点的态度改变,效果与人类撰写的信息相当。研究揭示了AI通过逻辑论证路径(使用更多facts和evidence)实现说服的独特机制,为AI在政治传播领域的应用与监管提供了重要依据。

在数字时代,人工智能正以前所未有的方式重塑信息传播格局。政治传播领域面临一个关键问题:当大型语言模型(LLM)能够生成复杂程度媲美人类的文本时,这些AI生成的内容是否真能像人类撰写的政治宣传一样改变人们的政策立场?这个问题不仅关乎学术理论,更涉及民主政治的基础――如果AI能以极低成本大规模生成有效说服材料,可能彻底改变政治竞选的游戏规则。

斯坦福大学的研究团队在《Nature Communications》发表的研究给出了肯定答案。通过三项精心设计的预注册实验,Hui Bai、Jan G. Voelkel等学者发现,GPT-3生成的200-250字政策主张文本,能在禁枪令、碳税等高度极化议题上显著改变受试者态度。令人惊讶的是,这些AI文本的说服效果(平均2-4个百分点变化)与人类撰写的宣传材料不相上下,且94%的读者未能识别出AI作者身份。

研究采用的关键技术方法包括:1)使用GPT-3/3.5生成标准化说服信息;2)通过Prolific.com和CloudResearch平台招募具有人口统计学代表性的美国受试者(N=4829);3)采用101点量表精确测量政策支持度变化;4)运用LIWC-22进行语言特征分析;5)通过中介分析揭示不同说服路径。

LLM生成信息显著改变政策态度

实验数据显示,阅读AI生成的禁烟令支持文本后,受试者支持度比对照组提升3.62个百分点(t(1198)=4.17)。在更具争议的突击武器禁令议题上,LLM信息仍能产生1.81个百分点的态度改变(t(2011)=3.16)。

人机说服效果的等效性

在直接比较中,LLM与人类撰写信息的态度改变幅度无统计学差异(Study1: b=0.26,p=0.787)。但中介分析揭示二者通过不同路径实现说服:AI依赖逻辑论证(间接效应=0.38)和事实呈现,而人类信息则依靠独特性(间接效应=-0.72)和叙事技巧。

党派认同的调节作用

强民主党支持者更易被AI说服(交互效应b=-5.16),反映出政治极化背景下,信息接收者的既有立场会显著影响AI说服效果。同时,政策初始支持度越高者,受AI信息影响越大(b=0.05)。

语言特征的系统性差异

文本分析显示,LLM信息使用更多7字母以上长词(25.58% vs 21.50%)和第一人称复数代词("we"),体现集体行动诉求;而人类文本更多使用第一人称单数("I")和否定词,凸显个人化表达。LLM文本的Flesch-Kincaid阅读等级更高(12.26 vs 11.14),但情感基调无显著差异。

这项研究首次实证证明了当前公开可用的LLM已具备与人类相当的政治说服能力,且通过独特的理性论证路径实现态度改变。其重要意义在于:1)警示AI可能被用于大规模政治操控,特别是在资源有限的竞选活动中;2)为AI内容标注和水印技术提供紧迫性依据;3)揭示了数字时代政治传播的新机制――当94%的受众无法识别AI作者时,传统基于来源可信度的说服理论需要重构。

研究者特别指出,由于实验中未测试虚假信息的说服效果,LLM在政治传播中的潜在危害可能被低估。随着GPT-4等更强大模型的涌现,建立相应的监管框架和数字素养教育体系已刻不容缓。这项研究为政策制定者敲响警钟:在AI可以"以理服人"的时代,我们需要新的规则来守护民主辩论的完整性。

生物通微信公众号

生物通微信公众号