-

生物通官微

陪你抓住生命科技

跳动的脉搏

基于视觉语言模型(VLM)的腹部超声标准切面智能质量评估系统AbVLM-Q的构建与验证

【字体: 大 中 小 】 时间:2025年08月24日 来源:BMC Medical Imaging 3.2

编辑推荐:

本研究针对腹部超声标准切面获取质量受操作者依赖性影响的关键问题,开发了基于视觉语言模型(VLM)的智能评估系统AbVLM-Q。通过多中心7,766例超声图像数据,采用分层提示(hierarchical prompting)和LoRA微调技术,实现了关键结构检测(精度98.10%)、切面分类(标签准确率98.96%)和图像评分(优秀级准确率85.11%)的三重突破,为超声质控标准化提供了AI驱动的新范式。

腹部超声作为无创、无辐射的检查手段,在肝胆筛查和急诊医学中占据重要地位。然而,标准切面的获取质量长期受三大"顽疾"困扰:新手医师对门静脉左支等解剖标志识别不准、肥胖患者声衰减(acoustic attenuation)干扰、老年患者呼吸配合困难。这些因素导致临床中高达30%的超声图像存在切面偏移或关键结构缺失,严重影响诊断可靠性。传统基于CNN的方法如Faster R-CNN虽能实现89.77%的结构召回率,但面临假阳性率高(163个/千例)、跨机构适应性差等瓶颈。

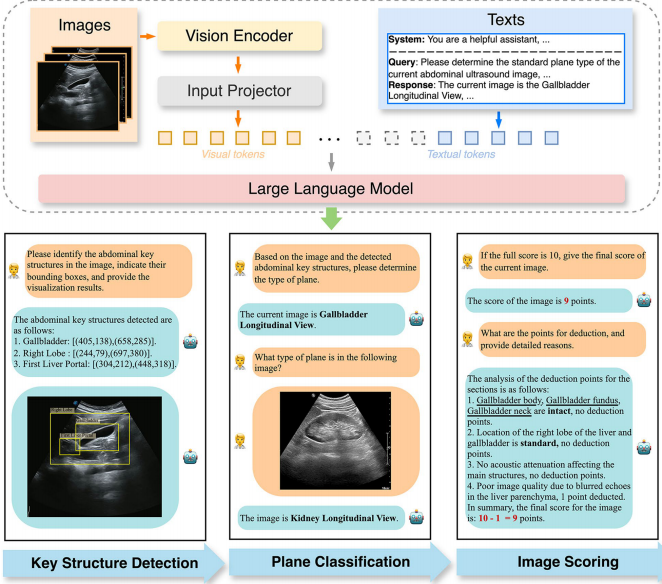

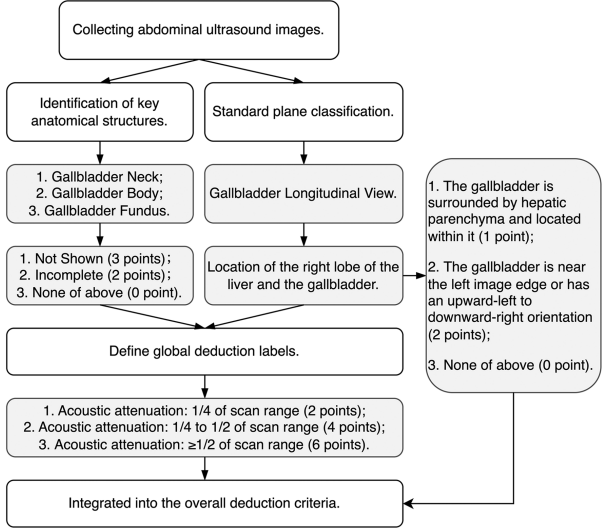

为突破这些限制,Wang Boahua团队创新性地将视觉语言模型(Vision-Language Model, VLM)引入超声质控领域。研究者从中国两家三甲医院收集7,766例腹部超声图像,构建包含11种标准切面的多中心数据集。通过三步走策略:1)开发空间感知查询与序列推理结合的分层提示框架;2)建立基于多级临床扣分标准的量化评分机制;3)采用LoRA(Low-Rank Adaptation)对预训练VLM进行参数高效微调,最终打造出AbVLM-Q系统。

关键技术方法包括:1)使用Qwen2-vl-2B作为主干网络,在16块NVIDIA RTX 3090显卡上以4e-5学习率微调7.3小时;2)设计三层提示体系(任务定义→结构化查询→评分推理)模拟临床思维;3)将临床指南转化为11类切面的扣分规则,如胆囊纵切面"颈体底不全显示扣3分";4)采用SWIFT框架实现监督微调,LoRA参数配置为秩16、α32。

【关键结构检测】

在IoU>0.5的标准下,Qwen2-vl-2B以88.30%召回率和98.10%精度显著优于Faster R-CNN(89.77%/88.64%)。特别在假阳性控制上,传统方法需调整置信阈值至0.99才能将FP降至6例,但召回率骤减至36.56%;而AbVLM-Q在默认参数下即保持25例FP,平均IoU达0.786,证明其捕捉解剖边界的优越性。

【标准切面分类】

在12类切面的多标签分类任务中,Qwen2-vl-7B以98.87%标签准确率和96.28%子集准确率刷新纪录,较最佳CNN模型(ConvNeXt-Tiny)提升1.12%和1.99%。值得注意的是,在资源受限的MobileNetV2上,传统方法子集准确率暴跌至79.05%,而轻量级DeepSeek-VL-1.3B仍保持91.43%的稳定表现。

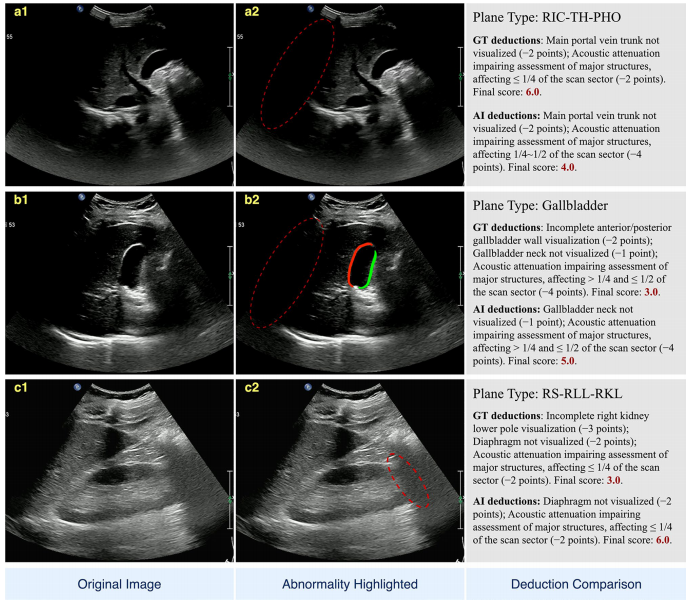

【图像质量评分】

对临床最关注的"优秀"级(8-10分)图像,Qwen2-vl-2B达到85.11%的判读准确率。混淆矩阵显示,各主干模型在优秀/良好(6-8分)区间的分类一致性达92%,但在中等/较差(4-6分)区间存在约15%的误判,主要源于声衰减区域的扣分边界模糊(如图6所示)。

这项研究首次证实VLM在超声质控中的三大优势:1)通过文本编码器将临床指南转化为可执行扣分规则,解决传统方法启发式规则编码的复杂性问题;2)分层提示机制实现88.9%的关键结构召回率,为实时超声导航奠定基础;3)LoRA微调使7B参数模型仅需15.2小时即完成适配,显著降低部署门槛。未来通过优化编码器对细微声像特征(如胰腺实质回声模糊)的敏感性,有望进一步缩小AI与专家在临界病例判断上的差距。

生物通微信公众号

生物通微信公众号

知名企业招聘